SEO w WordPressie opiera się na czterech filarach, które muszą działać jednocześnie, aby serwis mógł realnie dominować w wynikach wyszukiwania.

⭐ Filar 1: Techniczne SEO

Pierwszym z nich jest techniczne SEO, czyli fundament całej widoczności. Obejmuje ono poprawną strukturę adresów URL, właściwą indeksację strony, poprawnie wygenerowane mapy XML, dobrze ustawiony plik robots oraz prawidłowe użycie tagów canonical. Równie istotne są archiwa, kontrola duplikacji treści, obsługa błędów 404, logiczna struktura nagłówków, dane strukturalne schema oraz breadcrumbs, które pomagają zarówno użytkownikom, jak i robotom Google lepiej zrozumieć układ serwisu. Bez tych elementów nawet najlepsze treści nie będą w stanie osiągać wysokich pozycji.

⭐ Filar 2: SEO treści (Content SEO)

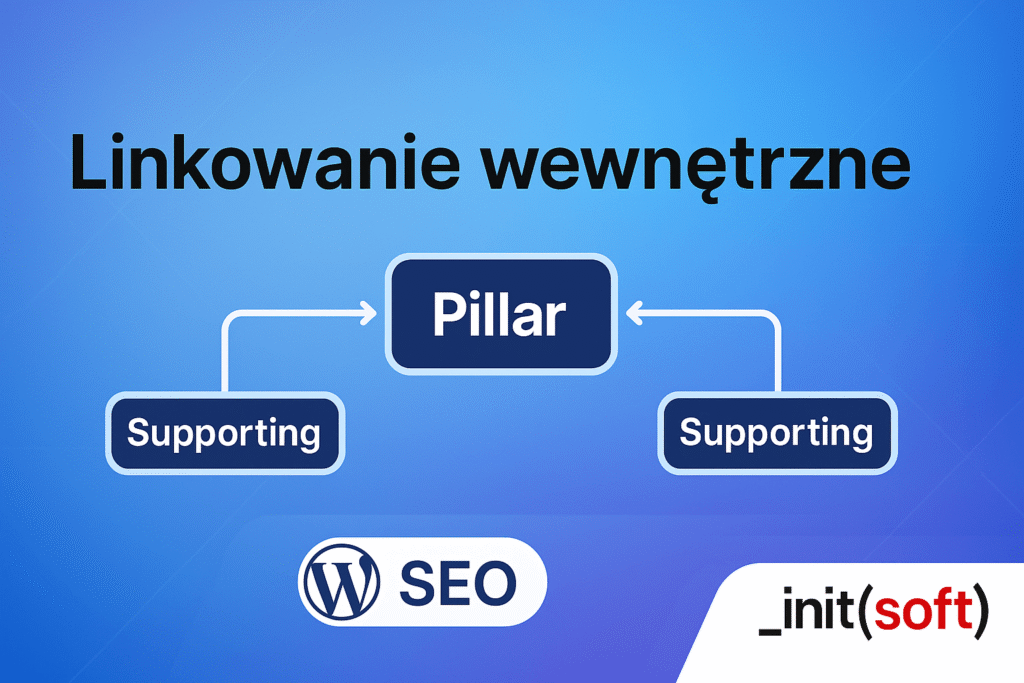

Drugim filarem jest SEO treści, czyli świadome tworzenie contentu pod wyszukiwarki i użytkowników jednocześnie. Kluczowe znaczenie ma tu rzetelny keyword research, który pozwala dobrać właściwe frazy i intencje wyszukiwania. Na jego podstawie buduje się strony filarowe typu pillar pages oraz wspierające je artykuły tematyczne, które razem tworzą klastry i wzmacniają topical authority serwisu. Ogromne znaczenie mają jakościowe nagłówki, treści eksperckie, które realnie odpowiadają na pytania użytkowników, oraz odpowiednia strukturacja tekstu, dzięki której treść jest czytelna, logiczna i łatwa do przetworzenia przez algorytmy.

⭐ Filar 3: Core Web Vitals i prędkość

Trzecim filarem są Core Web Vitals oraz szeroko rozumiana prędkość strony. Obejmuje to kluczowe wskaźniki takie jak LCP, INP i CLS, które wprost wpływają na ocenę strony przez Google. Równie ważna jest optymalizacja JavaScript i CSS, poprawnie wdrożony lazy load, skuteczny system cache oraz szybki, stabilny hosting. Nawet najlepiej zaprojektowana struktura SEO i najlepsze treści nie będą konkurować w wynikach wyszukiwania, jeśli strona ładuje się wolno i generuje słabe doświadczenie użytkownika.

⭐ Filar 4: Linkowanie wewnętrzne

Czwartym filarem jest linkowanie wewnętrzne, które spina całą strukturę SEO w jedną całość. Kluczowe jest tu kontekstowe linkowanie pomiędzy artykułami, budowanie klastrów tematycznych, przemyślana struktura menu oraz zastosowanie breadcrumbs, które porządkują hierarchię strony. Równie ważne są linki wewnętrzne prowadzące z artykułów do stron filarowych, ponieważ to one przekazują moc SEO i wzmacniają najważniejsze podstrony serwisu. Dopiero harmonijne połączenie tych czterech filarów sprawia, że WordPress w 2026 roku może być realnym liderem w wynikach wyszukiwania.

WordPress daje ogromną przewagę w SEO przede wszystkim dzięki pełnej kontroli nad strukturą adresów URL. Możesz precyzyjnie ustawiać ścieżki, usuwać zbędne parametry, budować logiczne struktury kategorii i podkategorii oraz tworzyć adresy przyjazne zarówno dla użytkownika, jak i dla algorytmów Google. Dodatkowo sam proces tworzenia treści jest szybki i intuicyjny, co sprzyja regularnej publikacji artykułów, rozbudowie serwisów tematycznych i skalowaniu widoczności bez barier technicznych.

WordPress świetnie sprawdza się również jako system do budowania dużych struktur contentowych. Pozwala szybko rozwijać kategorie, tagi i serie artykułów, co idealnie wpisuje się w model klastrów tematycznych, które obecnie są jednym z filarów skutecznego SEO. Dzięki temu można budować silne powiązania między treściami, wzmacniać topical authority i szybciej zdobywać wysokie pozycje na konkurencyjne frazy. Dodatkowym wsparciem jest RankMath, który potrafi zautomatyzować nawet 50% pracy związanej z metadanymi, schemą, mapami XML i podstawową optymalizacją on-site.

Ogromną zaletą WordPressa jest także dostępność wielu motywów projektowanych od początku z myślą o SEO oraz pełna kontrola nad kodem HTML i strukturą nagłówków. Możesz dokładnie zarządzać hierarchią H1–H6, semantyką treści, danymi strukturalnymi i elementami technicznymi, które w innych systemach są często mocno ograniczone. Co więcej, blogowanie jest naturalnym i wbudowanym elementem WordPressa, co bardzo ułatwia regularne publikowanie treści wspierających pozycjonowanie.

To wszystko sprawia, że WordPress jest dziś jednym z najlepszych, jeśli nie najlepszym, CMS-em pod kątem SEO na świecie. Trzeba jednak jasno powiedzieć, że ta przewaga działa tylko wtedy, gdy fundamenty techniczne są postawione poprawnie. Hosting musi być szybki i stabilny, wtyczki muszą być dobrane rozsądnie i zoptymalizowane, a używany builder nie może przeciążać strony nadmiarem zbędnych skryptów. Równie istotne jest to, aby treści nie były przypadkowe, lecz układały się w spójną, logiczną strukturę tematyczną. Dopiero połączenie tych elementów sprawia, że potencjał SEO WordPressa jest realnie wykorzystywany.

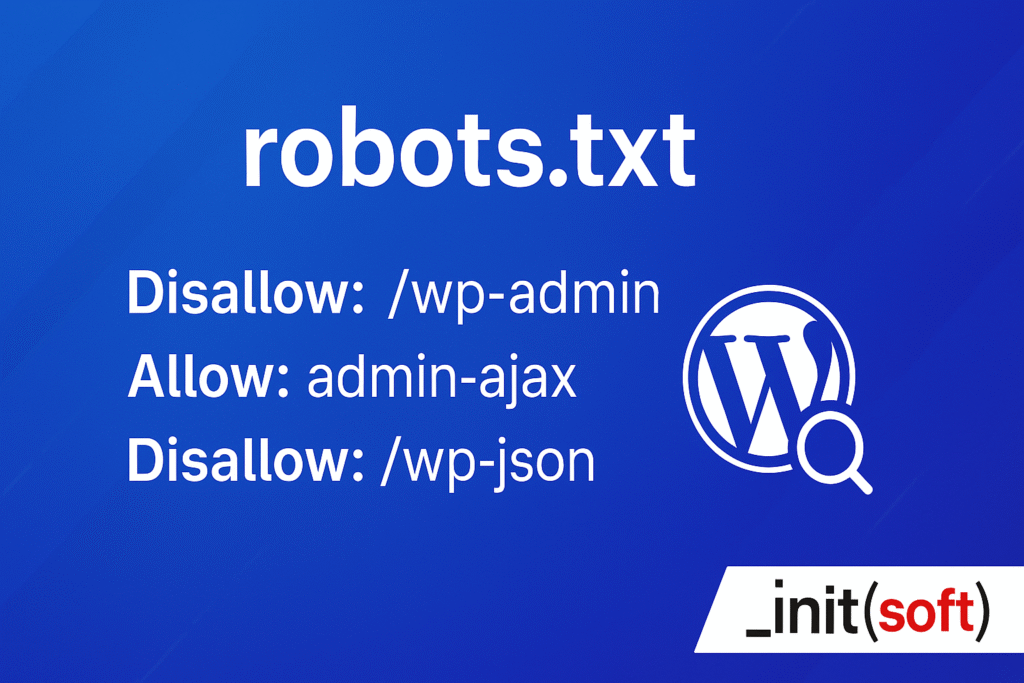

Plik robots.txt w WordPressie pełni kluczową rolę w kontrolowaniu tego, które zasoby serwisu mogą być skanowane przez roboty wyszukiwarek, a które powinny pozostać niewidoczne. WordPress posiada wiele katalogów technicznych, które nie mają żadnej wartości SEO, a jednocześnie mogą niepotrzebnie obciążać budżet indeksowania lub ujawniać strukturę zaplecza strony. Dlatego dostęp do panelu administracyjnego powinien być zablokowany dla robotów, z wyjątkiem pliku admin-ajax.php, który musi pozostać dostępny, aby poprawnie działały funkcje asynchroniczne.

Katalogi z wtyczkami i motywami również nie powinny być indeksowane, ponieważ nie zawierają one treści przeznaczonych dla użytkowników, a jedynie zasoby techniczne, które niepotrzebnie pojawiałyby się w indeksie Google. Podobnie sytuacja wygląda z katalogiem wp-json, czyli interfejsem REST API, który powinien być dostępny dla aplikacji i samego WordPressa, ale nie dla botów wyszukiwarek. Zablokowanie katalogu cgi-bin to z kolei standardowe zabezpieczenie przed niepożądanymi skryptami serwerowymi, które nie mają żadnej wartości z punktu widzenia SEO.

Niezwykle istotnym elementem poprawnego pliku robots.txt jest także wskazanie adresu mapy witryny. Dzięki temu roboty wyszukiwarek od razu wiedzą, gdzie znajduje się pełna, aktualna lista wszystkich indeksowalnych podstron. Ułatwia to i przyspiesza proces indeksacji, a także zmniejsza ryzyko pominięcia ważnych treści.

Dobre praktyki w zakresie robots.txt w WordPressie sprowadzają się więc do czterech kluczowych zasad: blokowania dostępu do wtyczek i motywów, blokowania REST API dla robotów, blokowania obszaru administracyjnego oraz aktywnego wskazania mapy strony. Tak skonfigurowany plik robots.txt porządkuje proces skanowania, zwiększa bezpieczeństwo i realnie wspiera skuteczne SEO.

Idealna wersja robots.txt:

User-agent: *

Disallow: /wp-admin/

Allow: /wp-admin/admin-ajax.php

Disallow: /wp-content/plugins/

Disallow: /wp-content/themes/

Disallow: /wp-json/

Disallow: /cgi-bin/

Sitemap: https://twojadomena.pl/sitemap_index.xml

WordPress zaczyna mieć realne problemy z indeksacją najczęściej wtedy, gdy fundament techniczny strony jest słaby. Kluczowym czynnikiem jest tutaj hosting o niskiej wydajności, który generuje wysoki czas odpowiedzi serwera, często przekraczający 800 ms TTFB. Dla robotów Google oznacza to wolne pobieranie stron, częstsze porzucanie crawlowania i ograniczanie budżetu indeksacji. Sytuację dodatkowo pogarsza zbyt duża liczba wtyczek, które obciążają bazę danych, zwiększają liczbę zapytań i spowalniają generowanie HTML. Problemy często potęguje także nieprawidłowo skonfigurowana wtyczka SEO, np. Yoast, który przy złych ustawieniach potrafi blokować ważne podstrony przed indeksacją lub generować błędne meta-dane.

Kolejną częstą przyczyną problemów z widocznością są błędy w pliku robots.txt, który nieświadomie blokuje dostęp do istotnych sekcji strony, a także brak poprawnie wygenerowanej mapy witryny XML. Bez sitemapy Google indeksuje stronę wolniej i mniej precyzyjnie, co szczególnie szkodzi nowym projektom oraz serwisom z dużą liczbą podstron. Bardzo poważnym problemem są również błędne adresy kanoniczne, które potrafią wskazywać wyszukiwarce niewłaściwą wersję strony jako główną, skutecznie wycinając właściwe URL-e z indeksu. Dodatkowo brak logicznego linkowania wewnętrznego sprawia, że roboty nie są w stanie efektywnie poruszać się po serwisie, przez co wiele podstron pozostaje osieroconych i nieindeksowanych.

Na problemy z indeksacją wpływa również sposób budowy strony. Ciężkie page buildery, które generują nadmiarowy i zagnieżdżony kod HTML, utrudniają robotom szybkie zrozumienie struktury treści i znacząco wydłużają czas analizy strony. W skrajnych przypadkach Google widzi ogromny bałagan w kodzie zamiast czytelnej struktury informacji, co negatywnie wpływa zarówno na indeksację, jak i na ocenę jakości strony.

W praktyce sytuacja wygląda zupełnie inaczej, gdy WordPress działa na szybkim hostingu LiteSpeed, korzysta z dobrze skonfigurowanego RankMatha, ma poprawną strukturę nagłówków, logiczne linkowanie wewnętrzne oraz czyste, przyjazne adresy URL. W takim środowisku roboty Google poruszają się po stronie błyskawicznie, indeksacja przebiega sprawnie, a nowe treści pojawiają się w wynikach wyszukiwania bardzo szybko, często w ciągu kilku godzin.